AIGC真如外界所宣传的那般美好吗?其背后的创新创业生态将如何构建?

作者:周志峰、胡奇

编者按:

今年以来,由游戏设计师杰森·艾伦使用 AI 绘图工具 Midjourney 绘制的作品《太空歌剧院》夺下了美国科罗拉多博览会的年度艺术比赛的首奖,引起艺术家和社交媒体的热议,也让AIGC(人工智能自动生成内容)概念成为AI界年度热词,并掀起了一股AIGC投资热潮。AIGC真如外界所宣传的那般美好吗?其背后的创新创业生态将如何构建?

从2012年AlexNet取得深度学习里程碑式的突破以来,启明创投在过去的十年中都是中国最活跃的人工智能投资机构之一,我们见证了人工智能从算法到应用的一次次突破和发展,对人工智能的前景我们始终保持着热情和理智。启明创投开设硬科技前瞻专栏,希望从创投视角深度解读前瞻技术突破,多维度剖析行业趋势,寻找新锐科技力量。

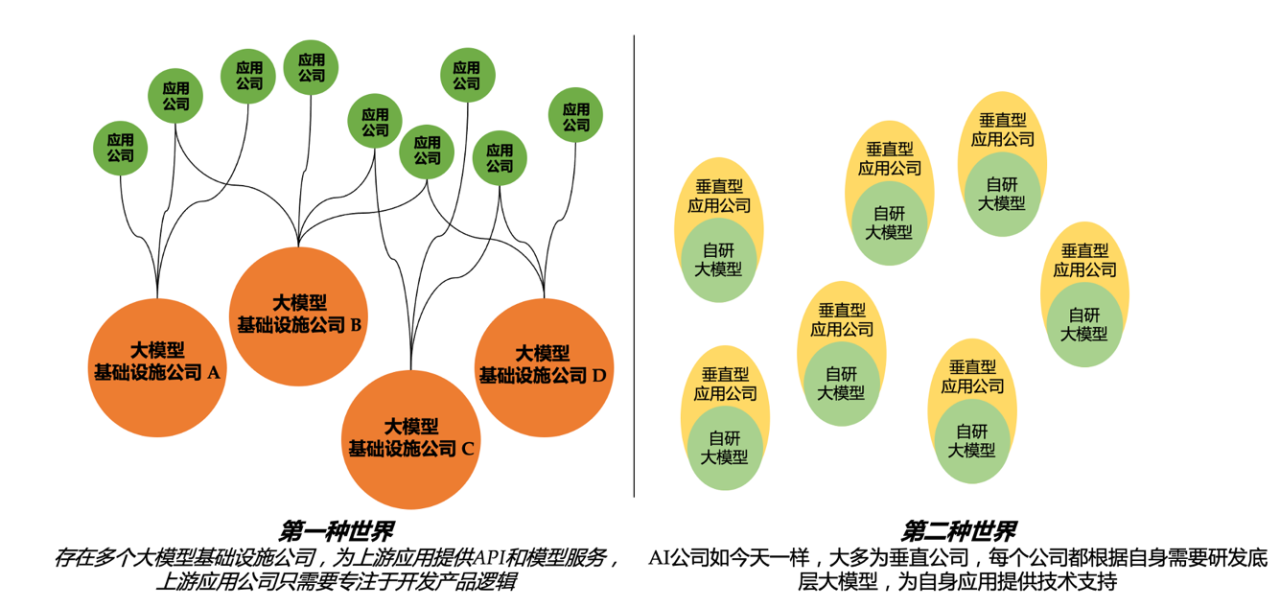

如果我和你说,未来AIGC可能有两种世界:一种世界是多个大模型基础公司,为上游应用提供API和模型服务,上游应用公司只需要专注于开发产品逻辑和上层算法;而另一种世界则如同今天的AI公司一样,每家公司都根据自身需求研发底层大模型,为自身应用提供技术支持。

你对任何一种世界的相信都将构成你当下投资和创业的选择,当然,这两种世界也可能存在互相交织的过渡形态,但需要你来对过渡形态的持续时间进行判断,你会选择相信哪一种世界?

AIGC的两种世界

先不用着急给出你的答案,再问你两个问题:

1、如果GPT-4,或者3年、5年后最好的模型比GPT-3大100倍甚至1000倍,作为创业公司是否还要自研?

2、在某个领域的底层基础模型尚未成熟的时候,选择在该领域进行创业是很好的timing吗?

如果你对未来的AIGC世界和这两个问题感兴趣,我们将进入今天的文章。我们将简单回顾近期热闹的AIGC,从中探寻AIGC在今年火爆的根本原因,并将结合强化学习奠基人之一Rich Sutton的“AI 70年惨痛的教训”和Jasper.AI、Copy.AI等公司的发展,做出我们对于这个世界的判断。相信看完以后,你也将会得出自己的答案。

引爆用户的AIGC

如果用一个字形容过去几个月的AIGC(AI Generated Content)/Generative AI那么应该是“火”。Midjourney的作品获得美国科罗拉多州博览会的数字艺术比赛一等奖,引发关注和广泛争论,有人戏称AIGC让每个画师都在担心失业。与此同时,今年相对沉寂的VC迎来新风口,连续轰炸的AIGC公司的融资消息和新闻让VC又一次产生FOMO (Fear of Missing Out)的情绪;DreamStudio、Midjourney等AI作画应用符合视觉消费的时代主题,引爆了C端热情。

Midjourney的获奖作品 - 太空歌剧院 Théâtre D’opéra Spatial

其实AIGC并不是一个新颖的概念,AIGC即用AI算法生成文本或者图像等内容,各种NLG(自然语言生成) 模型和GAN(生成对抗网络)及其变种模型都是此前的生成式AI模型。如果你打开谷歌搜索AIGC,会发现排在前面的基本都是中文网站,因此有人说AIGC是一个国产概念,与之对应的海外概念是Gartner在2019年提出的Generative AI,为统一理解,本文将采用AIGC来表达AI生成内容。

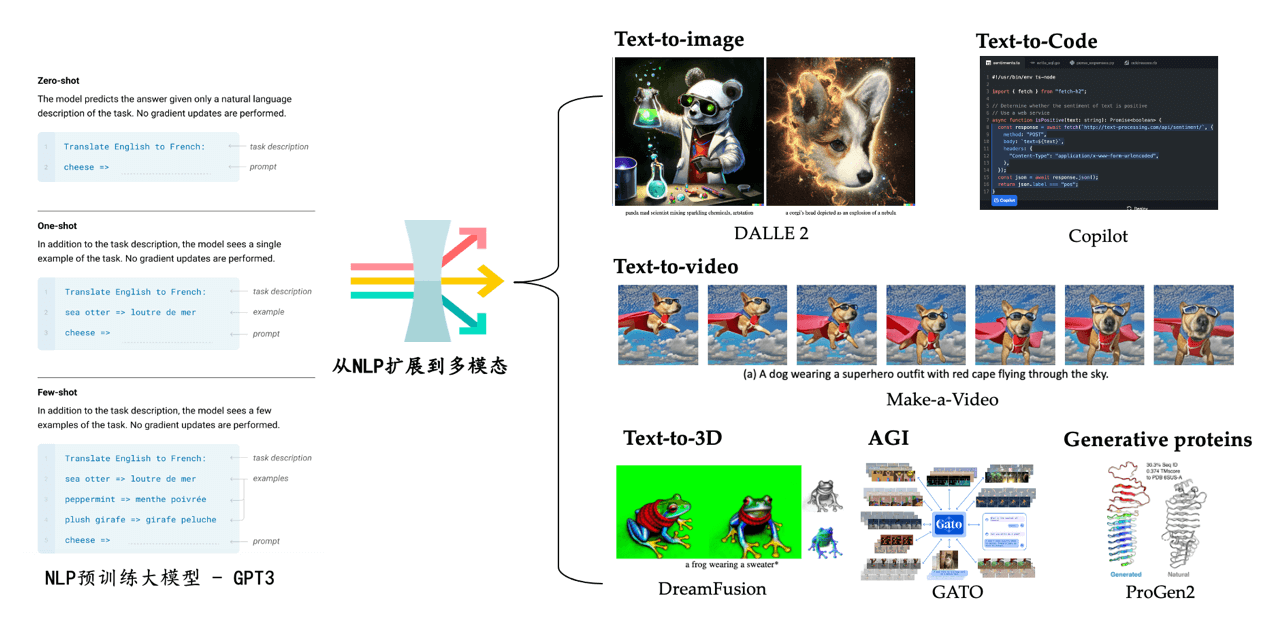

我们观察到新一波AIGC浪潮起源于2020年的预训练大模型GPT-3,现在火爆的图像生成、视频生成、3D生成等,本质是大模型从文本生成扩展到多模态,并结合原有模态算法进行实现(当然,以图片生成图片等本模态之间的AI生成,以及图像生成视频、2D生成3D等跨模态生成也是AIGC,例如VAE、StyleGAN、Nerf等与AI生成相关的模型都在GPT-3发布之前或之后提出,但这些方向的工作并非引爆新一波AIGC的主要原因)。因此,我们看到的大量AIGC应用,目前的表现形式大多为输入一句话,生成一句话/一张图/一段视频/一串代码等。

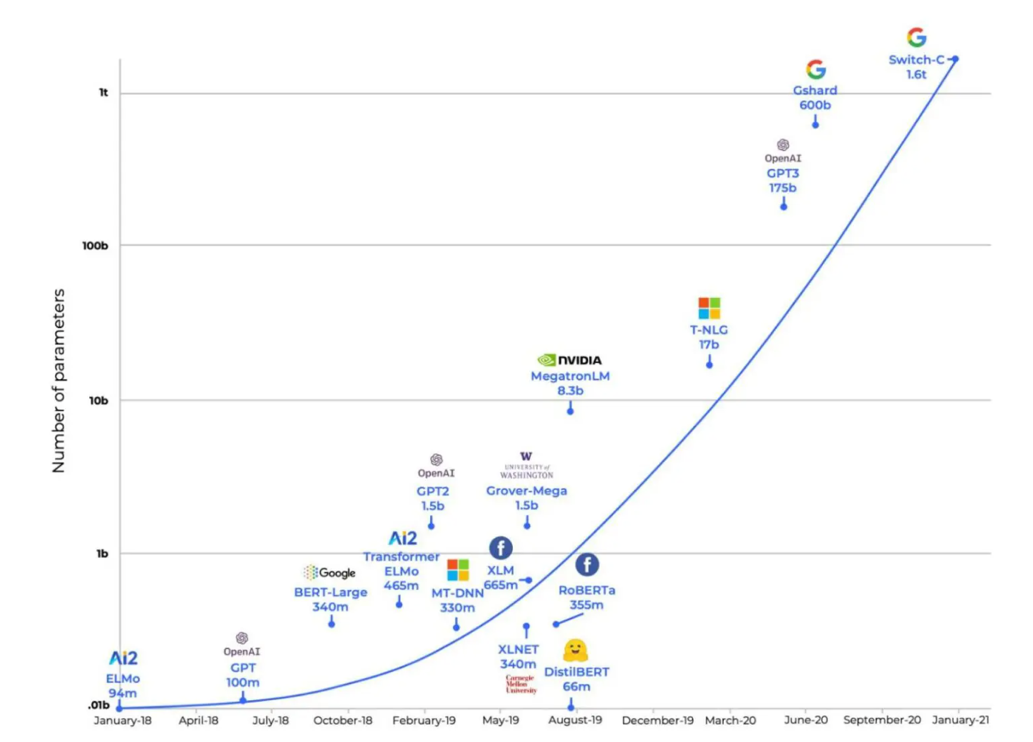

1750亿参数的GPT 3曾一度是AI历史上最大的机器学习模型,相比于15亿参数量的GPT 2,GPT 3参数量提高约117倍,预训练的数据量也从50 GB提高到的570 GB。2020年发布GPT 3的时候,OpenAI并没有将工作重点放在模型结构的创新上,反而是进行了大量工程化的工作,充分展示GPT 3通过Zero-Shot、One-Shot和Few-Shots(即不需要额外数据进行微调,直接给出几个样例就可以让模型做出正确的生成)等Prompt方法完成多种NLP任务的通用性和泛化能力。通过释放出API接口供公众调用,GPT-3的商业化也正式提上日程。GPT-3展示出惊人的效果后,一年后顶级实验室和科技大厂陆续发布自己的NLP预训练大模型,模型参数量呈现指数级别的增长。

深度学习模型中参数数量的指数级增长

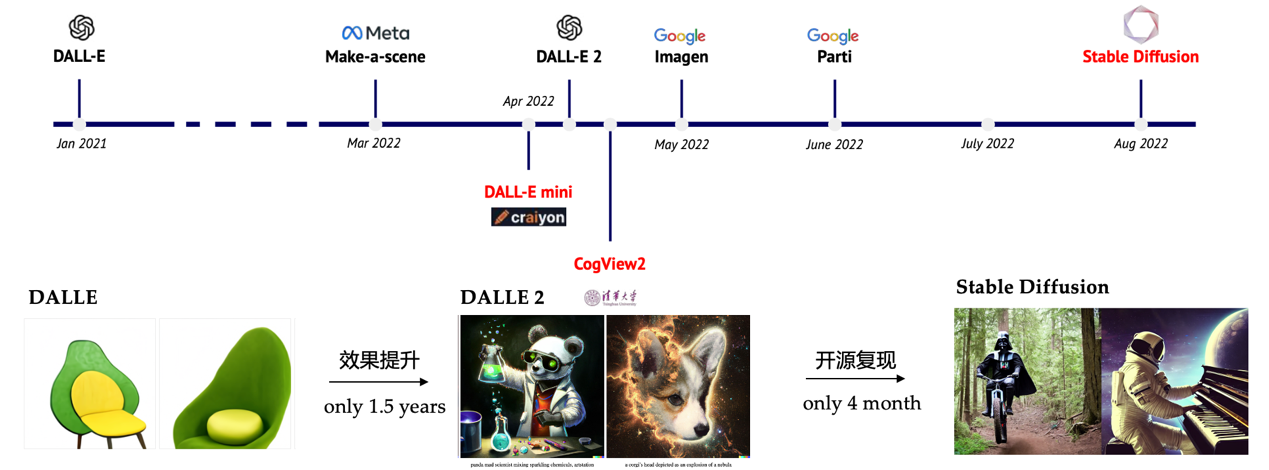

随后的一年内,OpenAI进行了多次多模态的探索,其中最知名的是Text-to-image系列模型DALLE和DALLE2。

OpenAI在2021年1月发布初代Text-to-Image 模型 DALL-E,虽然相比于此前作画模型进展惊人,但效果并未让大众惊艳,因此只在学界引发了巨大的关注。2022年4月,OpenAI再次发布第二代Text-to-Image 模型 DALL-E 2,效果极好,但OpenAI仅用一篇未公布细节的论文展示其成果,并仅为审核通过的开发者提供接口试用。2022年8月,借鉴Dall-E 2的思路,Stable Diffusion模型开源,至此,AI图像生成开始爆发。

DALLE、 DALL-E 2和其他开源模型的发布时间线与效果

时间轴图片来源:State of AI Report 2022, https://www.stateof.ai/

总结AI生成图像发展滞后于生成文本,但却在2022年下半年爆发的原因,我们不难发现如下规律,上一层级的AIGC往往依赖于下一层级的AIGC发展到一定程度,如Text-to-Image依赖于Text-to-Text本身的算法发展相对成熟,同理,我们推测Text-to-Video也需要依赖Text-to-Image和其他视频预测算法(如视频插帧)的发展成熟,因此,我们可以对不同复杂度的AIGC内容的进化路线得出以下推论:

AIGC中不同内容的进化路线

AIGC为何引起新一波热潮?

如果分析新一波AIGC得到发展的原因,最直接的结论是因为大模型(如GPT-3、Dalle2、Stable Diffusion等)带来了非常好的效果和泛化能力。

其实从GPT-3出现之前,早在2018年3.4亿参数的Bert模型在当时已经算是巨无霸级别的存在,只是没有想到短短2年内,模型参数就提高到了GPT-3的1750亿。3.4亿参数的Bert将SQuAD 1.1的F1得分提高到93.16分,超过人类的表现,并用屠榜的成绩赢得了多项NLP测试。但直到GPT-3的出现,NLP模型才可以更好地完成NLG任务,并且对Few-shots的运用更加娴熟。

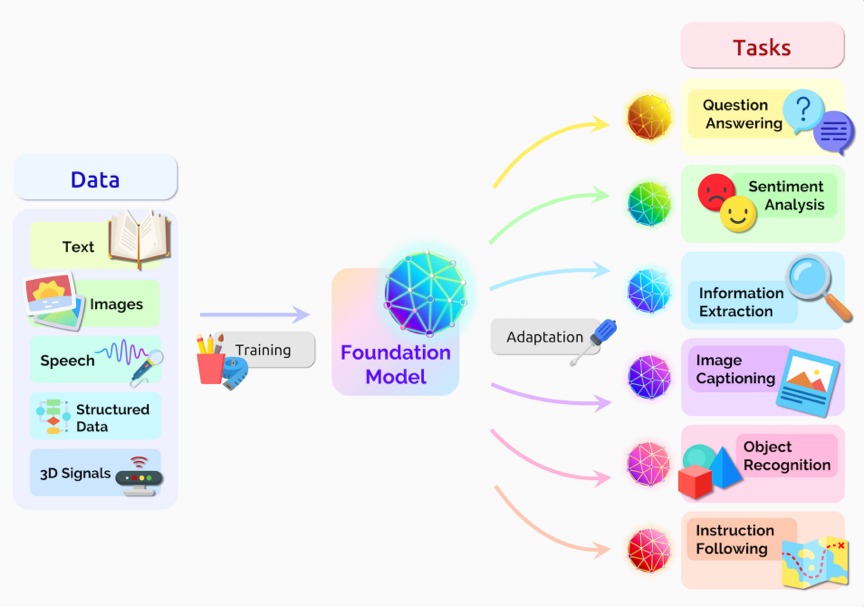

大模型还展示出了强大的泛化能力,GPT-3的API接口让下游的应用公司可以不需要迁移学习就直接将AI能力应用到自己的任务中,API接口发布不到1年内就吸引了约300家公司调用其API,也印证了在2021年8月斯坦福大学教授李飞飞等100多位学者联名发表的200多页的研究报告On the Opportunities and Risk of Foundation Models中关于大模型(统一命名为Foundation Models)可以集中来自多种模态的所有数据的信息,并直接适用于多种下游任务的构想。借助GPT-3的API接口,OpenAI也逐渐从独立的实验室走向大模型的基础设施公司。

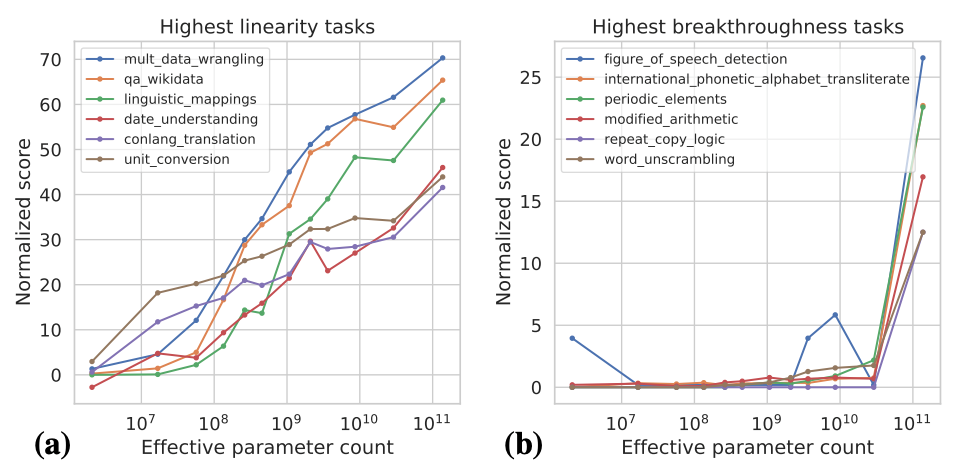

图片来源:论文On the Opportunities and Risk of Foundation Models

但如果进一步对为什么大模型能够带来更好的效果和泛化性进行分析,我们目前还只能通过实验而非清晰的理论进行解释。的确大多数情况下更大规模的模型会带来更好的效果,但具体原因尚未被探明,学术界也存在很多探讨。在最新的一篇关于大模型的研究论文中,作者通过实验证明了大多数任务的效果随着模型的增大而提高——在一些任务中,随着模型增大而效果类似线性相关地变好的情况,作者将这类任务定义为Linearity Tasks,同样,也有一些任务需要模型规模超过某个临界点后,会突然出现相应的能力,此后在随着模型规模的增大而提升效果,作者将这类任务定义为Breakthroughness Tasks。(当然,也存在少部分任务的效果随着模型增大而降低)。

图片来源:论文Beyond the Imitation Game: Quantifying and extrapolating the capabilities of language models

同样,论文Emergent Abilities of Large Language Models中也有类似的实验证明,当模型达到临界大小时,许多NLP能力会不可预测地出现——涌现规律。

如果再进一步追问为什么模型可以越做越大,则不得不提到Transformer的优点。Transformer解决了并行化训练和长依赖问题,能够容纳更多的参数规模,为模型进一步做大提供了基础,而大模型带来了更好的效果和泛化性,提供了超过以往的生成能力,引发了新一波AIGC的爆发。

Transformer提供的并行化和对全局信息掌控能力,对算力的充分挖掘和利用,也近乎完美地符合2019年 DeepMind杰出科学家、强化学习的奠基人之一的Rich Sutton在文章The Bitter Lesson中论述的观点——从过去70年的人工智能研究中可以得到的最大教训,是利用计算的一般方法最终是最有效的,而且效果提升幅度很大。

在文章中,Rich Sutton通过列举深度搜索超过人类知识设计的算法而在计算机国际象棋中击败人类冠军、隐性马尔可夫模型在语音识别领域战胜基于人类知识的算法、计算机视觉中深度学习使用卷积超过此前搜索边缘和以SIFT特征为基础的方法,论证了为了寻求在短期内有所作为的改进,研究人员更倾向于利用人类对该领域的知识,但从长远来看,唯一重要的是对计算的利用。

然而, Rich Sutton关于“长远来看,唯一重要的是对计算的利用”的观点,当时并没有引发业界的强烈关注,甚至在大模型促进AIGC蓬勃发展的今天,很多创业者和投资人仍然没有对这句话的意义足够重视。

目前关于GPT-4流行着两种传言,第一种是生成GPT-4并不会比GPT-3的参数规模大太多,预计是几千亿级别的参数量,但会使用更大量的数据进行训练;另一种传言是GPT-4的规模将会比GPT-3大至少一个量级。不管哪一种传言是对的,如果我们认真思考Rich Sutton的“长远来看,唯一重要的是对计算的利用”这一观点,则很难避免的需要回答这样一个问题“如果GPT-4,或者3年、5年后最好的模型比GPT-3大100倍甚至1000倍(这里的100倍,可能是模型参数量、也可能是训练使用的数据量),作为AIGC应用侧的初创公司还是否要自研?”

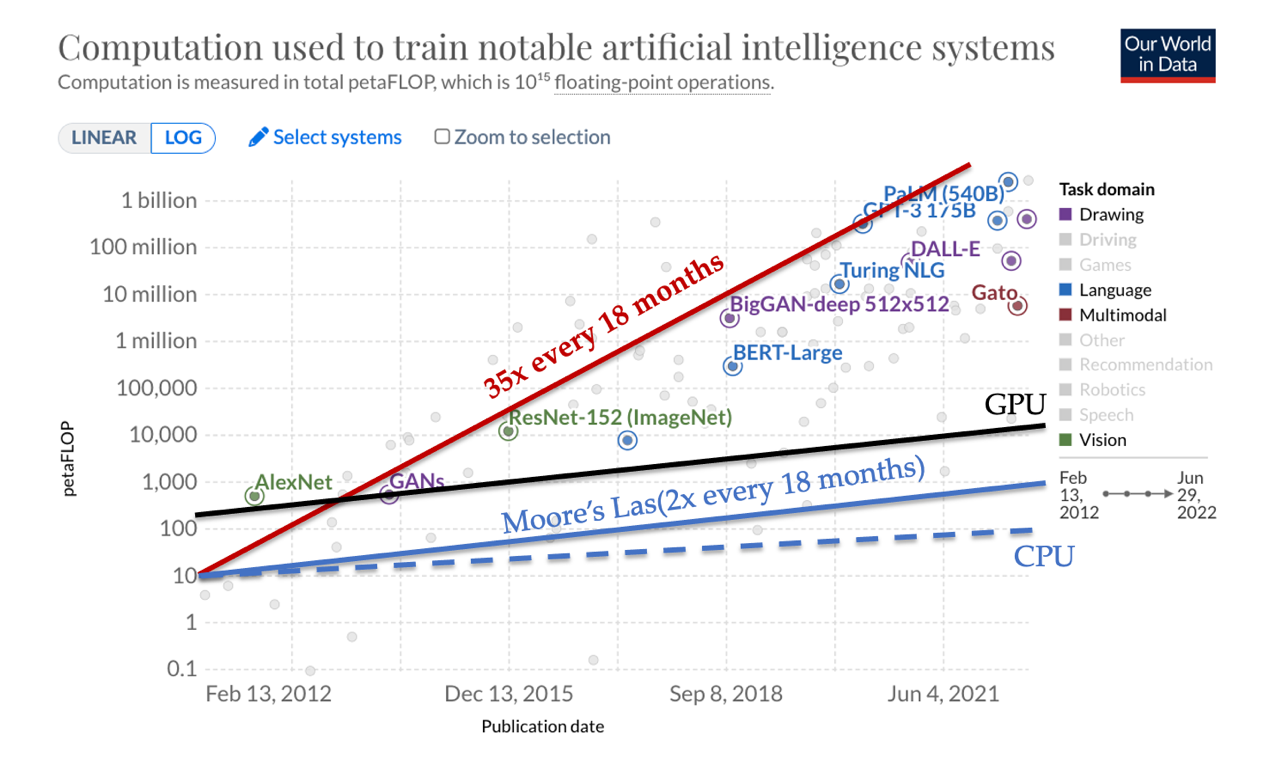

2012年至今,表现最好的模型参数每18个月增加35倍,增速远超摩尔定律

我们在今天热闹的AIGC创业氛围中,有时会听到这样的一种乐观言论—市场上能够调用的大模型API效果并不好,我们需要得到一笔融资,去研发自己的大模型,有了自研的大模型,我们想要做的杀手级别的应用(如写作助手、图画生成等等)就会取得更好的效果,最终赢得客户。持这种论调的创业者,大多有着不错的技术背景,并且大概率在AI领域有过一些值得人尊敬的成果。然而,Rich Sutton之所以得出惨痛的教训,正是因为基于这样的历史观察:1)人工智能研究者经常试图将认知加入到他们的模型中,2)这在短期内总是有帮助的,并且对研究者个人来说是满意的,但是3)从长远来看,它的影响趋于平稳,甚至抑制了进一步的进展,4)突破性的进展最终通过一种与之对立的方法,是基于搜索和学习这样能够扩展计算的方法。

这样的观察与上文我们观察到的一些论调非常相似,今天创业者希望通过利用与自身业务相关的数据、经验、技巧等去自己构建当下的最好的大模型,的确有机会在自身领域带来超过今天大模型基础设施公司公开提供API的效果,然而这也同样意味着企业要一直分配一大部分精力和资金在基础模型的研发上,那自然放在业务上的资金和精力则会减少。PMF(Product-market fit)以及PMF之后的业务拓展,都需要企业投入全部的精力来完成,这大模型所需要耗费的研发投入和资金成本显然与集中精力做PMF有一些矛盾。

对于以上的问题,目前AIGC创业公司中已经实现PMF和商业化拓展的两个代表性公司Copy.AI和Jasper.AI并未纠结。前者在成立的一年内实现了1000万美元的ARR,而后者则更是厉害,在成立的2年内实现了4000万美元的ARR,预计在今年实现9000万以上的ARR。两者的共同点都是基于选择了使用GPT-3提供的API进行创业,并在GPT-3提供的API的基础上,在前端做了大量的控制算法和产品逻辑,并集中精力打磨产品。

值得警惕的是,大模型是一直在进步的,耗费的成本也越来越高。OpenAI 1750亿参数的GPT-3耗费了大约500万美元的训练资金,Stability.AI也在维护一个4000 多个Nvidia A100 GPU组成的集群来训练AI模型,显然这么大的训练费用对于创业公司是一个压力。虽然Stable Diffusion已经开源,但在图文生成领域还有更多进步的空间,目前来看Stability.AI的方向并非成为图像侧的应用公司,而是成为大模型领域的基础设施公司(可能类似于hugging face)。那么不禁要问,如果有一天Stability.AI像OpenAI一样,并不再开源其最先进的模型,而是提供商业化调用的时候,创业公司是否还要选择自研大模型来保持最先进,如果回答是Yes的话,资金又要从哪里募集呢?

另外一个值得注意的问题是,目前Stable diffusion开源模型所展示的效果并没有在图像领域达成如GPT-3在NLP领域一样的效果,虽然其C端火爆的现象仍然持续,然而如果真的转化成B端的通用生产力工具,Stable diffusion还存在无法针对图像做更细节的生成(如手部效果等)、无法制定某个特定区域修改乃至修改后与原场景十分融洽、无法控制画作中不同元素(实体)进行单独修改等诸多问题(截止发稿前,Stable diffusion2.0已经在11月24日发布,变化包括对分辨率的提升、引入图片编辑功能等,但上述问题仍然未得到充分解决)。简而言之,目前除了NLP领域的大模型是相对成熟以外,图像的AIGC模型尚且处于早期,视频、3D、游戏等内容的AIGC模型则处于更早期阶段。因此创业者需要回答的另一个问题是“当底层基础模型尚未成熟的时候,是选择在该领域进行创业很好的timing吗?是否应该等到底层模型相对成熟且API就位后才是更好的创业timing?”

以Text-to-Image领域为例,自然会有一些勇敢的创业者会去提高当前Stable diffusion的效果,自己训练前端的CLIP模型,甚至自己训练后端的Diffusion模型。的确,在当前模型没有发展到一定程度时,拿到一笔钱后做出比当下市场上最好的模型效果还要好的模型,并为业务产生更好的效果的想法确实非常诱惑,这个想法下能够展示出的Demo、优秀的AI团队,可能也是令VC沉醉的。但回顾NLP的历史,如果Copy.AI、Jasper.AI并未在2020年OpenAI研发出GPT-3并开放接口后再选择创业,而是在2015年、2018年拿着当时的模型去选择做营销助手的创业,其成功的概率会有多大?而从目前的市场情况来看,图像、视频领域则尚未出现与Jasper.AI和Copy.AI类似的、已经实现超过千万ARR的新的应用类创业公司,更多是原来已经存在的应用公司通过新的模型进行业务能力的增加。相信除了Stable Diffusion模型开源的时间尚短以外,也有着当前最好的模型亦尚未成熟的原因。也许,在图像等其他内容领域,目前时代还在呼唤着与OpenAI类似的提供API的基础设施类公司,然后才是应用生态繁荣的开始。

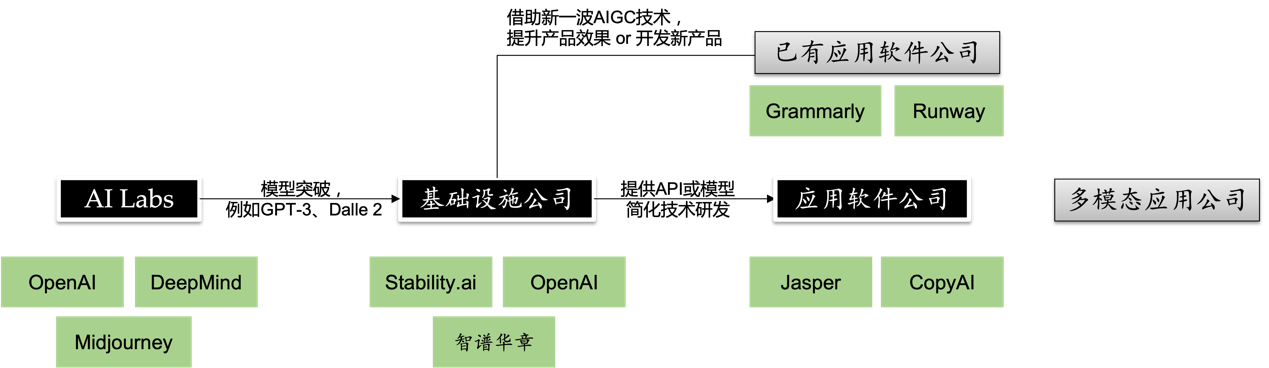

参考国外AIGC不同类型的公司出现的节奏,可以发现如下规律:

第一步,顶级实验室研发革命性的模型

第二步,实验室或者AI科学家成立基础设施公司,提供API和模型对外服务

第三步,具备行业经验的产品人才利用基础设施公司提供的API,专注于打磨自身应用,服务客户

从NLP到其他模态(如图像、视频、3D等),以上规律反复出现。

当前NLP国内外都已经出现基础设施公司提供API接口,国外有OpenAI、Cohere等公司,国内也出现了智谱华章这样研发出超大规模预训练模型(效果在多个公开评测集上性能超过GPT-3)并提供模型服务市场(Model as a Service)的基础设施公司。

有了基础设施公司提供相对成熟的API服务,启明创投将持续关注NLP杀手级应用;而图像、视频、3D等领域,尚未出现能够提供商用API的基础设施公司(Stable Diffusion和Midjourney有可能是第一批图像领域的基础设施公司)。

启明创投同样会关注在大模型时代前就成立,专注于垂直领域的应用公司,他们将在新一波AIGC浪潮中借助大模型的能力,推出新产品和或者大幅提升原有产品效果(例如Notion和RunwayML)。此外,在两个世界过渡的过程中,能够拿到高额融资的垂直一体AI公司仍然有可能在时间窗口中占据有利地位(例如AI21lab和Character.ai),我们对此类机会同样保持关注,但会更加谨慎。

当然,就像是恐龙时代中,哺乳动物作为弱小的生物并不显眼,但却最终面对各种恶劣的环境生存下来并开枝散叶一样。从2012年AlexNet取得深度学习里程碑式的突破以来,启明创投在过去的十年中都是中国最活跃的人工智能投资机构之一,我们见证了人工智能从算法到应用的一次次突破和发展,对人工智能的前景我们始终保持着热情和理智。我们将对目前发展的元学习、新一代AI推理或者其他使用更小数据量和参数量的模型发展保持关注,也许未来有一天transformer不再是最优范式,垂直应用的世界会再次到来。

但是,在此之前,第二种世界向第一种世界的过渡看起来无法避免,要知道虽然恐龙最终灭绝,但灭绝之前,他们曾作为霸主统治地球1.6亿年。

关于作者

署名作者均为启明创投TECH投资团队成员,周志峰是启明创投合伙人,胡奇是启明创投投资经理。